Intelligence artificielle : quels impacts sur l’économie et la société ?

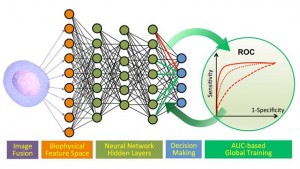

Les progrès de la recherche en intelligence artificielle en ont fait un sujet incontournable des tendances de la décennie actuelle. Annoncées depuis les années 1960, les avancées dans cette discipline complexe se sont confirmées depuis les années 2000, grâce, notamment, au ‘machine learning’ (apprentissage automatique : les machines ‘apprennent’ à partir des jeux de données qui leur sont proposés) et à son dernier développement le ‘deep learning’ qui s’appuie sur les ‘réseaux de neurones’ : des algorithmes de machine learning sont utilisés pour entraîner les couches profondes de réseaux de neurones. Plutôt que de modéliser de vastes quantités d’information (ex : calculer tous les coups possibles dans une partie d’échec), les réseaux de neurones apprennent tout seuls en digérant des millions de données (Maddyness). Combinés avec des mégadonnées (big data), ces intelligences artificielles réalisent des opérations et des actions qui dépassent en rapidité et en pertinence les actions humaines. Cela explique le succès de ces technologies cognitives au Web Summit de Lisbonne en novembre dernier où robots et véhicules autonomes ont joué les vedettes.

Les progrès de la recherche en intelligence artificielle en ont fait un sujet incontournable des tendances de la décennie actuelle. Annoncées depuis les années 1960, les avancées dans cette discipline complexe se sont confirmées depuis les années 2000, grâce, notamment, au ‘machine learning’ (apprentissage automatique : les machines ‘apprennent’ à partir des jeux de données qui leur sont proposés) et à son dernier développement le ‘deep learning’ qui s’appuie sur les ‘réseaux de neurones’ : des algorithmes de machine learning sont utilisés pour entraîner les couches profondes de réseaux de neurones. Plutôt que de modéliser de vastes quantités d’information (ex : calculer tous les coups possibles dans une partie d’échec), les réseaux de neurones apprennent tout seuls en digérant des millions de données (Maddyness). Combinés avec des mégadonnées (big data), ces intelligences artificielles réalisent des opérations et des actions qui dépassent en rapidité et en pertinence les actions humaines. Cela explique le succès de ces technologies cognitives au Web Summit de Lisbonne en novembre dernier où robots et véhicules autonomes ont joué les vedettes.

Les exemples des récents succès de l’automatisation et de l’IA se multiplient : les taxis autonomes, comme Lyft à Boston ; la prévention des suicides grâce à leur détection sur les messages Facebook, la prédiction (réussie) de la personne de l’année au magazine Time, la découverte de nouvelles exoplanètes dans un partenariat Google-NASA, etc. Comme le souligne Olivier Ezratty dans son post, l’intelligence artificielle n’est pas un produit. Il n’y a pas de logiciels d’intelligence artificielle mais des solutions d’intelligence artificielle très variées qui s’appuient sur plusieurs dizaines de briques logicielles différentes qui vont de la captation des sens, notamment audio et visuels, à l’interprétation des informations, au traitement du langage et à l’exploitation de grandes bases de données et de connaissances structurées ou non structurées.

Combinée avec une voix de synthèse, Chaï, une application d’intelligence artificielle permet d’écouter sur son téléphone mobile la suite d’un livre papier à l’endroit exact où l’on s’est arrêté. Cette application convient plus à un documentaire qu’à un ouvrage de fiction. Idéal pour réviser ses cours dans les transports en commun ! Les fichiers audios comportent des dictionnaires qui enrichissent le texte, en transformant par exemple les sigles et acronymes en termes développés. Et comme le confirme Alexis Botaya, qui présentait ce produit au salon HumainxMachines, aucun problème de droit d’auteur en raison d’un accord avec les éditeurs : le traitement s’effectuant à partir du fichier de l’ouvrage avant son impression et le client doit avoir acheté le livre papier.

Au Japon, l’entreprise Tasei se propose de lutter contre le surmenage de ses employés en leur envoyant des drones bourdonner autour d’eux et leur jouer « Auld Lang Syne », la chanson écossaise qui signale au Japon la fermeture des magasins … Comme l’explique Nelly Lesage dans Numérama, les Japonais peuvent effectuer plus de 80h d’heures supplémentaires par mois ! Le modèle T-Frend est doté d’une caméra qui surveille le comportement des employés et se déclenche quand ils dépassent les horaires. Pour une fois, la surveillance est utilisée pour le bien-être des travailleurs !

En Chine, la reconnaissance faciale est généralisée dans la vie quotidienne et le piéton qui traverse au feu rouge est vite repéré et sa photo affichée au carrefour ! Comme l’explique Leng Biao, professeur de vision informatique à Pékin, cité dans l’article du Monde, « L’important ce sont les algorithmes. Quand il s’agit de reconnaitre une personne dont on a la photo, la reconnaissance faciale est très fiable, on trouve même des logiciels gratuits sur internet ». Et comme en Chine les gens sont moins préoccupés des questions de vie privée, cette méthode est bien acceptée…

Ces performances se sont multipliées depuis une quinzaine d’années et ne manquent pas de soulever controverses et inquiétudes aussi bien parmi les scientifiques et géants du net (Stephen Hawking, Elon Musk et Bill Gates) que dans le grand public. Laurent Alexandre, le chirurgien et homme d’affaire, voudrait au contraire, « casser la gueule à l’Europe pour avancer ». Comme le souligne Pierre Cheminade dans la Tribune, pour le créateur de Doctissimo l’Europe a déjà perdu la bataille du numérique et « que pour ne pas perdre la guerre et sortir d’une situation de « colonie numérique sans souveraineté », la France doit renforcer la recherche en intelligence artificielle et supprimer la protection des données personnelles. ».

Ces préoccupations autant éthiques que réglementaires ont amené le gouvernement français à confier au mathématicien et député Cédric Villani, une mission sur ce sujet, accompagnée d’une consultation publique. Au niveau européen, Margarethe Vestager, commissaire européenne à la concurrence, est intervenue au Web Summit pour affirmer que le marché unique européen n’a pas vocation à être régi par « la loi de la jungle, mais par la démocratie à l’œuvre, pour le respect de la concurrence au service de l’innovation » .

Les principaux secteurs impactés

De nombreux secteurs et services sont déjà ou seront bientôt touchés par ces innovations technologiques, et ce à différents niveaux.

- Les transports avec les véhicules autonomes

- La santé avec des programmes de détection de maladies (cancers)

- La relation client avec l’utilisation d’agents conversationnels et de traitement automatique de courrier électronique

- La sécurité avec la reconnaissance faciale et les technologies de vision artificielle

- L’urbanisme avec la ville connectée (smart city)

L’enseignement, la psychothérapie, le journalisme, la politique et même la littérature pourraient être touchés par cette vague d’automatisation. Mais pour le moment toutes les professions ‘créatives’ sont relativement épargnées.

Des informations contradictoires sur les conséquences socio-économiques et l’emploi de l’automatisation de l’industrie et des services se multiplient sans s’annuler pour autant … Nelly Lesage dans son article de Numerama évoque « un rapport du cabinet McKinsey & Cie qui estime que 800 millions de travailleurs perdront leur emploi d’ici 2030, en raison de l’automatisation ». Cette « invasion des robots » touchera surtout les pays les plus avancés, comme l’Allemagne et les Etats-Unis. Les métiers impliquant une interaction humaine, comme les médecins, les avocats, les enseignants et les barmen, devraient, quant à eux être préservés. La vidéo publiée dans le Monde « Serons-nous un jour remplacés par des intelligences artificielles » cite une étude du cabinet Roland Berger de 2014 qui prévoit que 3 millions d’emplois pourraient disparaître d’ici 2025 à cause des intelligences artificielles ! Et les métiers engendrés en retour par le secteur robotique ne compenseront pas ces disparitions. Plus préoccupant encore, ces mesures ne se limitent pas aux métiers simples et répétitifs … Dans son article de l’Usine digitale, Christophe Bys, en revanche, cite une étude internationale de Cap Gemini selon laquelle « les entreprises qui ont recours à l’intelligence artificielle n’ont majoritairement pas détruit d’emplois. Elles en ont même créé. ». Toutefois cette étude qui relativise l’impact de l’IA porte sur un périmètre restreint d’entreprises (dont le chiffre d’affaire est supérieur à 500 millions de dollars). Les pays européens (France, Espagne, Pays-Bas) ont déployé moins d’initiatives IA que l’Inde ou l’Australie …

C’est aussi le point de vue de Bertrand Diard, président de Tech in France, dans son interview dans la Croix « La robotisation dans l’industrie n’a pas réduit le volume d’emplois. Ce qui l’a fait, ce sont les délocalisations vers la Chine. L’Allemagne, qui est très robotisée, a créé de la richesse et de l’emploi industriel, alors que la France, dans le même temps, en a perdu. » De nouveaux métiers devraient émerger autour de ces nouvelles technologies et il faut développer la formation des travailleurs qui pourraient ainsi s’adonner à des tâches plus intéressantes. Alain Guillemolles a interviewé dans le même article Romain Guers, délégué syndical au Crédit Mutuel. Cette banque a adopté Watson, l’agent intelligent d’IBM (ce chatbot est aussi en fonction chez Orange et Bouygue Telecom) pour l’assister dans le traitement des données de la relation clients : « il n’est pas question de remplacer les conseillers bancaires par des robots. […] l’outil ‘intelligent’ aide les chargés de clientèle à trier le courrier en fonction des priorités exprimées par les clients. De plus, ils ont accès à un « assistant » qui peut répondre à certaines demandes d’information en épargne et assurance. Mais le conseiller commercial reste le pivot de la relation avec le client. ». Là aussi, la mise en place de l’outil IA n’a pas eu d’impact sur l’emploi. Pour le moment, car les outils intelligents apprennent très vite …

On retrouve ici les deux conceptions de l’IA : d’une part, l’IA comme assistant de l’humain qui permet de réaliser l’’homme augmenté’, doté de sortes de prothèses technologiques ; d’autre part, l’IA autonome qui arriverait à une sorte de ‘conscience’ !

Dans la recherche médicale, en revanche, l’outil intelligent n’est pas encore vraiment fiable. Watson devait permettre aux soignants « de passer moins de temps sur la littérature et plus de temps pour prendre soin des patients ». Comme le souligne Jean-Yves Paillé dans la Tribune, « L’IA destinée à trouver des solutions afin de personnaliser les traitements en cancérologie est pour le moment décevante, en particulier dans les diagnostics ». Le système souffre d’un certain nombre de biais : d’abord dans les publications scientifiques : sur 700 000 articles publiés par an en médecine, de nombreuses publications n’ont pas de valeur. « La machine n’est pas capable aujourd’hui de faire la différence entre ce qui ne vaut rien et un article intéressant » comme l’analyse Guy Vallencien dans

Dans la recherche médicale, en revanche, l’outil intelligent n’est pas encore vraiment fiable. Watson devait permettre aux soignants « de passer moins de temps sur la littérature et plus de temps pour prendre soin des patients ». Comme le souligne Jean-Yves Paillé dans la Tribune, « L’IA destinée à trouver des solutions afin de personnaliser les traitements en cancérologie est pour le moment décevante, en particulier dans les diagnostics ». Le système souffre d’un certain nombre de biais : d’abord dans les publications scientifiques : sur 700 000 articles publiés par an en médecine, de nombreuses publications n’ont pas de valeur. « La machine n’est pas capable aujourd’hui de faire la différence entre ce qui ne vaut rien et un article intéressant » comme l’analyse Guy Vallencien dans

« La médecine sans médecin » cité dans l’article. De plus près de 2% des scientifiques admettent « avoir fabriqué, falsifié ou modifié des données ou des résultats au moins une fois. » « jusqu’à 33,7% ont avoué d’autres pratiques de recherche douteuses » d’après l’étude de Plos One. Mais aussi l’intelligence artificielle s’appuie sur des données médicales spécifiques aux protocoles de soins des Etats-Unis et aurait du mal à s’adapter aux méthodes de différents pays où les protocoles peuvent différer … « L’IA ne peut pas être plus neutre et performantes que les données dont elle dispose ».

Ethique et réglementation

L’éthique fait partie des principaux axes définis par la mission Villani et concerne de nombreux aspects du déploiement de ces technologies. Aux États-Unis, les géants du numérique, Google, Apple, Facebook, Amazon, Microsoft, IBM ainsi que de nombreux chercheurs s’engagent pour développer une intelligence artificielle responsable et éthique. Le Partnership on AI to benefit people and society (Partenariat sur l’IA au service des citoyens et de la société), organisation à but non lucratif, a pour objectif la compréhension du public sur l’IA et la définition de meilleures pratiques dans ce domaine.

Au Québec, le préambule de la Déclaration de Montréal a été dévoilé en clôture du Forum sur le développement socialement responsable de l’intelligence artificielle le 3 novembre. Portant sur les thèmes de la cybersécurité, la responsabilité légale, la psychologie morale, le marché du travail, le système de santé et la ville intelligente, le Forum a comme ambition la ‘coconstruction’ entre le public, les experts et les pouvoirs publics. Comme l’a déclaré Guy Breton, recteur de l’UdM « Les avancées de l’intelligence artificielle toucheront progressivement tous les secteurs de la société et nous devons poser, dès maintenant, les balises qui encadreront son développement afin qu’il soit conforme à nos valeurs et porteur d’un véritable progrès social.»

En France, la CNIL dans son rapport des enjeux éthiques des algorithmes et de l’intelligence artificielle, présenté le 15 décembre, réaffirme deux principes fondateurs et préconise six recommandations opérationnelles pour permette à l’Homme de garder la main. Tout d’abord, le principe de loyauté : l’intérêt de l’utilisateur doit primer ; un principe de vigilance/réflexivité ensuite en organisant « un questionnement régulier, méthodique et délibératif à l’égard de ces objets mouvants ». Ces principes pourraient s’inscrire dans une nouvelle génération de garanties et de droits fondamentaux à l’ère numérique.

Parmi les recommandations : former à l’éthique tous les acteurs-maillons de la ‘chaîne algorithmique’ ; rendre les systèmes algorithmiques compréhensibles ; encourager la recherche sur l’IA éthique ; renforcer la fonction éthique au sein des entreprises. Comme le dit Isabelle Falque-Pierrotin, Présidente de la CNIL « L’objectif de ce débat est de garantir que l’intelligence artificielle augmente l’homme plutôt qu’elle ne le supplante et participe à l’élaboration d’un modèle français de gouvernance éthique de l’intelligence artificielle ».

Alexandra Yeh évoque dans son compte-rendu de la Conférence Nouvelles pratiques du journalisme de l’Ecole de Journalisme de Sciences Po, la proposition de Dominique Cardon pour une ‘éducation des algorithmes’. Comme on s’en est rendu compte dans les années 1980, les tentatives de programmer les machines à raisonner comme des humains avec des règles et des systèmes de décisions logiques sont vouées à l’échec. L’humain n’est pas un être pleinement rationnel et ses décisions dépendent souvent de facteurs imprévisibles (contextes, affects, sensibilité). Il faut donc « apprendre aux machines à analyser nos comportements plutôt que nos représentations ». Pour Dominique Cardon « nous devons réfléchir à la façon dont voulons éduquer les algorithmes ». Car nous sommes responsables des biais de l’IA (cf le cas des IA racistes).

Avec l’automatisation, les dilemmes moraux vont se multiplier : en plus de gérer les actions accidentelles ou intentionnelles de leurs inventions, les chercheurs en AI devront faire face à de tels dilemmes. Par exemple, face à une situation de danger, l’IA de la voiture autonome devra décider qui épargner en cas d’accident : une femme enceinte ou un homme âgé ; renverser un enfant ou deux adultes ? En fait, décider lesquels d’entre nous devront vivre ou mourir … Jean-François Bonnefons, professeur à la Toulouse School of Economics, explore ces dilemmes avec le projet Moral Machine qui « confronte les internautes à ce genre de situations pour leur demander de trancher, a déjà recueilli 40 millions de décisions ». Ce programme permet d’identifier les critères pesant dans la décision, les variations selon le type de personne (genre, âge, CSP, nationalité) et les différences culturelles et géographiques. Si les choix moraux sont relativement homogènes (sauver les humains plutôt que les animaux ), les résultats montrent qu’il n’existe pas de règle d’éthique totalement universelle, même si des convergences locales existent dans le monde …

A l’instar des avancées de l’intelligence artificielle, les préoccupations éthiques et politiques à ce sujet sont un « work in progress ». Nous aurons l’occasion d’y revenir à l’avenir.

Bonnes fêtes et meilleurs vœux pour 2018

Bonnes fêtes et meilleurs vœux pour 2018

Pour aller plus loin

L’intelligence artificielle, quelles conséquences pour l’emploi. – Les Numériques – Dossier, 17/12/17

Comment permettre à l’Homme de garder la main ? Rapport sur les enjeux éthiques des algorithmes et de l’intelligence artificielle. – CNIL, 15 décembre, 2017

Cheminade, Pierre. – Laurent Alexandre : « La France a perdu sa souveraineté numérique ». – La Tribune, 13/12/17

Georges, Benoît. – Ce que les Français attendent de l’intelligence artificielle. Les Échos, 12/12/17

Paillé, Jean-Yves. – Dans la santé, Watson, l’IA d’IBM, doit encore faire ses preuves. – La Tribune, 08/12/17

Simonite, Tom. – Artificial Intelligence seeks an Ethical Conscience. – Wired, 12/07/17

Lausson, Julien. – Intelligence artificielle : la Mission Villani vous demande votre avis. – Numérama, 07/12/17

Tisseron, Serge. - IA, robots qui parlent et robots sous influence. – InaGlobal, 06/12/17

Yeh, Alexandra. – IA et journalisme : quelle éthique ? – Meta-media, 05/12/17

#NPDJ Les nouvelles pratiques du journalisme 2017. – École de journalisme de Sciences Po, 04/12/17

Lesage, Nelly. – Un rapport estime que les robots vont prendre 800 millions d’emplois d’ici 2030. – Numérama, 30/11/12

2067, des robots dans la ville/Usbek & Rica. – Inriality, 28/11/17

Kiefer, Bertrand ; Navaris, Sophie. – « La médecine, le dernier lieu où l’on peut exprimer sa sensibilité » Entretien. – Tribune de Genève, 25/11/17

Maignan, Iris. – #Étude : les Français, pas (du tout) prêts pour l’intelligence artificielle. – Maddyness, 25/11/17

Web Summit 2017 à Lisbonne : que retenir du Davos de la Tech ? - FrenchWeb, 16/11/17

Guillemoles, Alain. - Watson mène la révolution de l’intelligence artificielle. – La Croix, 13/11/17

Deluzarche, Céline. – #IA : Deep learning, le grand trou de l’intelligence artificielle. – Maddyness, 13/11/17

Quel sera l’impact de l’intelligence artificielle sur l’emploi. – La Croix, 13/11/17

Piquard, Alexandre. – L’intelligence artificielle, star inquiétante du Web Summit à Lisbonne. – Le Monde, 10/11/17

Déclaration de Montréal pour un développement responsable de l’intelligence artificielle. – Université de Montréal, 03/11/17

Gavois, Sébastien. – Intelligence artificielle : enjeux économiques et cadres légaux s’invitent au Sénat. – NextInpact, 26/10/17

Ezratty, Olivier. – Les usages de l’intelligence artificielle. – Opinions libres, 19/10/17. – E-book téléchargeable.

Intelligence artificielle, une nouvelle mission confiée à France Stratégie. – France Stratégie – Premier Ministre,16/10/17

Yann Le Cun ; « Aujourd’hui, Facebook est entièrement construit autour de l’intelligence artificielle » Entretien. – Le Monde, 03/10/17 – vidéo.