Métavers, utopie ultime ou transformation des plateformes

L’annonce de Mark Zuckerberg en fin d’année dernière n’a pas véritablement surpris les spécialistes. En renommant son entreprise « Meta » et en transformant les différents services numériques en un ‘métavers’, le patron de Facebook ne fait que suivre une tendance que d’autres acteurs du numérique ont déjà anticipée, notamment dans le monde des jeux en ligne. Qu’est-ce donc que cet univers où tout un chacun pourraient s’adonner à ses activités (échanger, consommer, se distraire) sur un mode virtuel et sous la forme d’un avatar ?

L’annonce de Mark Zuckerberg en fin d’année dernière n’a pas véritablement surpris les spécialistes. En renommant son entreprise « Meta » et en transformant les différents services numériques en un ‘métavers’, le patron de Facebook ne fait que suivre une tendance que d’autres acteurs du numérique ont déjà anticipée, notamment dans le monde des jeux en ligne. Qu’est-ce donc que cet univers où tout un chacun pourraient s’adonner à ses activités (échanger, consommer, se distraire) sur un mode virtuel et sous la forme d’un avatar ?

A la faveur du confinement dû à la pandémie, un certain nombre d’activités et d’événements étaient passé sur la scène virtuelle et de nombreuses plateformes proposaient de transformer leurs services. Jusqu’à Jean-Luc Mélenchon qui s’est représenté par son hologramme dans un meeting, puis aujourd’hui avec des vidéos immersives et olfactives !

Outre les jeux en ligne (Fortnite d’Epic Games, Animal crossing, GTA), le télé-enseignement et le télétravail ouvraient des classes et des salles de réunion virtuelles, où parents et enfants se partageaient la bande passante !

Le métavers va-t-il renouer avec l’utopie humaniste des débuts de l’internet ou n’est-il qu’une transformation plus profonde des plateformes numériques en leur permettant de continuer leurs activités économiques habituelles sur un mode virtuel ?

Définitions et premières expériences du métavers

« Un métavers (de l’anglais metaverse, contraction de meta universe, c’est-à-dire méta-univers) est un monde virtuel fictif. Le terme est régulièrement utilisé pour décrire une future version d’Internet où des espaces virtuels, persistants et partagés sont accessibles via interaction 3D.

Une définition différente considère « le métavers » comme l’ensemble des mondes virtuels connectés à Internet, lesquels sont perçus en réalité augmentée. » (Wikipedia)

Le métavers est donc une sorte de copie du monde réel en immersion en trois dimensions qui devrait prendre la suite d’internet, où les utilisateurs évoluent dans des environnements fictifs sous forme de personnages numériques (avatars). Il est accessible par des moyens informatiques (ordinateur, smartphone, équipement de réalité visuelle). Il est persistant, c’est-à-dire qu’il existe de façon continue, comme le monde réel. Si un utilisateur se déconnecte, le métavers continue à ‘vivre’ et à se développer sans lui.

Ce concept se retrouve dans de nombreuses œuvres de science fiction, mais a surtout été développé par l’écrivain Neal Stephenson dans son roman « Le Samouraï virtuel » (Snow Crash) en 1992. Un informaticien hacker et livreur de pizzas qui vit misérablement dans l’Amérique de la ‘gig-economy, passe ses meilleurs moments dans le monde virtuel qu’il a contribué à créer. A cette époque, la technologie n’était pas encore mûre pour implémenter un tel univers virtuel, mais cet ouvrage a été considéré comme le ‘cahier des charge’ du métavers. De nombreux aspects de cet univers se retrouvent aujourd’hui dans les réalisations possibles des métavers : aspects économiques et financiers avec les investissements du monde réel dans le monde virtuel, le code informatique comme loi, le mode d’accès à l’aide de lunettes ou d’une interface bio-intégrée (les casques de réalité virtuelle) etc.

Premières expériences

En 1997, Canal + Multimedia et Cryo lancent le Deuxième monde : cette reconstitution de Paris en 3D permet aux membres de cette communauté de se rencontrer à travers des avatars. J’ai personnellement testé ce logiciel, mais je n’en ai pas gardé un souvenir inoubliable ! Mon avatar, plutôt ridicule, avait suscité des réflexions ironiques de la part d’autres membres … Cette expérience s’est arrêtée en 2001.

Second Life, créé par Linden Lab en 2003, est à la fois un jeu et un réseau social, il permet à ses utilisateurs d’incarner des personnages virtuels dans un monde créé par les résidents eux-mêmes. Les utilisateurs peuvent concevoir le contenu du jeu : vêtements, bâtiments, objets, animations et sons, etc., ainsi qu’acquérir des parcelles de terrain dont ils obtiennent la jouissance en utilisant une monnaie virtuelle. Ayant connu un pic d’utilisateurs entre 2007 et 2009 – tous les candidats à la présidentielle de 2007 y avaient ouverts des bureaux virtuels, plus de 88000 connexions en 2009 – la plateforme connaît un déclin à partir de 2012. La crise des subprimes de 2008 et la création de Facebook, plus facile à utiliser, pourraient expliquer cette désaffection. Malgré son acquisition par une autre compagnie, la plateforme n’a pas disparu et a connu une légère augmentation de connexions en 2020, pendant le confinement. Certains utilisateurs pensent même lui redonner une seconde jeunesse en misant sur les NFT, comme le signale Amandine Joniaux dans le Journal du Geek, citant le fondateur du jeu, Philip Rosendale.

Les métavers aujourd’hui

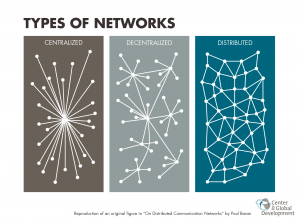

Comme on l’a vu Mark Zuckerberg n’a pas inventé le concept de métavers et d’autres sociétés ont développé des plateformes logicielles qui se déploient aussi dans une dimension virtuelle.Comme le prédit Frédéric Charles dans ZDNet, « Finalement on commence à entrevoir une multitude de Métavers, et non un univers unifié par ses standards comme Internet s’est construit. On découvre chaque jour de nouveaux bourgeons sur cette branche de l’Internet, que certains appellent déjà le Web3. »

Les autres GAFAMs, bien sûr, Amazon avec le jeu vidéo New World depuis 2020, Apple a un projet pour 2022 avec un casque de réalité virtuelle. Microsoft, enfin, qui est en train de transformer son logiciel de communication professionnelle Team en Mesh, univers de télétravail et surtout qui a l’intention d’acquérir pour près de 70 milliards de dollars l’éditeur de jeux Activision Blizzard. Cette transaction servira de base à la création de Microsoft Gaming, une nouvelle division qui englobera l’ensemble des marques de jeux pour PC, consoles et smartphones du fabricant de Windows, ainsi qu’un autre projet très important, peut-être même plus important encore : son projet d’entrer dans le « metaverse », comme le souligne Michael Gariffo dans ZDNet.

D’autres acteurs venus des jeux en ligne multijoueurs, comme Roblox ou Epic Game (Fornite), misent aussi sur le développement des métavers. A la faveur du confinement, en avril 2020 le rappeur Travis Scott a réuni plusieurs millions de spectateurs pour une série de concert en ligne sur Fortnite et Décentraland prépare pour mars 2022 sa première semaine de mode avec des défilés de grands couturiers comme Gucci, Dolce & Gabbana ou Ralph Lorenz, annonce Anne-Lise Klein dans Cointribune.

Baidu, en Chine et Zepeto en Corée du Sud ont mis en œuvre chacune leur propre univers virtuel. Disponible uniquement en Chine depuis le 27 décembre 2021, XiRang, (Terre d’espoir) l’application de réalité virtuelle accessible sur téléphone portable, ordinateur ou casque de réalité virtuelle permet à ses utilisateurs sous la forme de de personnages numériques (avatars) d’interagir dans un monde en 3D. Ils peuvent se rendre dans une exposition (virtuelle) ou une reproduction du temple de Shaolin ou encore se baigner dans une piscine numérique … Toujours en Chine, d’autres géants du numérique comme ByteDance (TikTok), Tencent ou Alibaba réfléchissent aux diverses opportunités offertes par le métavers comme l’indique Le Monde.

La plateforme Zepeto a été créée en 2018 et compte déjà 250 millions d’utilisateurs. Elle vient d’être valorisée à un milliard de dollars et est populaire aussi bien en Corée du Sud qu’en Chine, au Japon et en Indonésie. L’univers de Zepeto rappelle celui de Second Life « Un autre moi dans un autre univers » « retrouver des amis du monde entier à l’endroit où vous voulez ». Les avatars peuvent se croiser, se parler, mais aussi acheter des vêtements, construire des maisons, créer des cartes. Mais surtout, les utilisateurs sont surtout des utilisatrices : 70% sont des femmes, la plupart entre 13 et 24 ans. C’est souvent le premier réseau social qu’elles utilisent. Car en plus de maîtriser leur apparence, elles évitent la pression des autres réseaux sociaux. Comme l’évoque Aurore Gayte dans Numérama, « les utilisatrices expliquent pouvoir mieux échapper aux regards des autres sur Zepeto et aux mauvaises influences ». Toujours en Corée du Sud, le projet ‘Metaverse Seoul’ du gouvernement coréen devrait faire de la capitale du pays la première ville dans le métavers. Les résidents de la ville pourront se promener dans les rues, assister à des festivals, acheter des objets virtuels dans les commerces, faire des démarches administratives, etc.

Le Metavers comme espace économique et financier

Si les métavers proviennent souvent du monde des jeux et se présentent comme des plateformes gratuites, la plupart des projets proposent des activités commerciales et financières et disposent souvent de leur propre monnaie, virtuelle mais convertible dans des devises bien réelles !

Déjà Second Life au pic de sa popularité avec des centaines de milliers de résidents déclarait un produit intérieur brut de 500 milliards de dollars, comme le souligne Andrew R. Chow dans Time. Pendant les dix ans qui ont suivi son lancement, les utilisateurs de Second Life ont dépensé 3,2 milliards de vrai argent dans différentes transactions !

Ce n’est pas pour rien que Facebook compte investir 50 milliards de dollars dans Meta et embaucher 10 000 ingénieurs en Europe !

Outre la vente d’objets virtuels dans les boutiques qui ouvrent dans les artères du monde virtuel, le métavers connaît une importante activité foncière. Tout un chacun veut acheter un terrain et faire construire près de la demeure d’une star. Un anonyme vient de payer 450 000 dollars une parcelle dans the Sandbox, tandis qu’en décembre, Republic Realms a acheté une propriété toujours dans le même métavers pour la somme de 4. 300 000 de dollars, comme l’indique Les Echos du 11 janvier.

Les différentes activités et secteurs économiques du metavers

Doublure du monde réel, le métavers compte de nombreuses activités qui impliquent des transactions économiques. Nous avons déjà évoqué l’importance du foncier et des commerces qui fleurissent dans l’univers virtuel. Souvent liés aux jeux en ligne, les achats servent à améliorer l’aspect et l’environnement des avatars.

Des événements comme les concerts ou les défilés de mode peuvent aussi présenter un aspect économique, avec la création de NFT comme les marques de luxe l’ont réalisé sur la plateforme MANA de Décentraland, voir l‘article de Anne-Lise Klein sur Cointribune.

Les réunions de travail qui se sont multipliées grâce à Zoom ou Meet pourraient se développer avec des applications 3D comme le projet Mesh de Microsoft qui se propose de déployer son appli Teams.

L’enseignement à distance pourrait aussi avoir sa version metavers comme Winkyverse, une application ludo-éducative en 3D, développée par des ingénieurs et des chercheurs de l’école Polytechnique. Un projet qui a déjà récolté 20 millions d’euros.

Les métiers du métavers

Les utilisateurs de ce monde ne sont pas seulement des consommateurs, il existe plusieurs activités rémunérées qui permettent de gagner sa vie en travaillant dans le multivers comme :

- créateur de mode pour avatars

- architecte de maisons virtuelles

- créateur de NFT (Non Fungible Token)

- créateur de jeux ou d’applications

- formateur en ligne

Et bien sûr l’activité de banque et de cryptomonnaie qui permet de réaliser toutes ces transactions virtuelles et surtout de les transformer en revenus dans le monde réel…

« En novembre, la société de gestion d’actifs numériques Grayscale a estimé que le métaverse a le potentiel de devenir une source importante de revenus allant jusqu’à 1000 milliards de dollars » indique Anne-Lise Klein dans Cointribune.

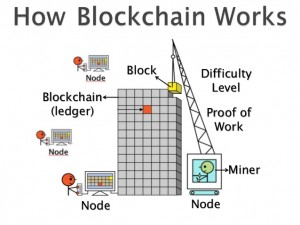

Les NFT et les cryptomonnaies

Les ‘jetons non fongibles’ (Non Fongible Tokens NFT) « sont des titres de propriété rattachés à une œuvre. Ces jetons établissent un lien indéfectible entre un objet et une adresse sur une blockchain. Ils permettent de monétiser, d’échanger et de spéculer sur tous les actifs imaginables, aussi bien dans le monde réel que virtuel. Ce marché connaît un engouement spéculatif mondial depuis 2020. « les ventes de « jetons non fongibles » ou NFT sur la plateforme leader OpenSea dépassent déjà les 2 milliards de dollars cette année, contre 22 milliards sur l’ensemble de l’année 2021. » comme le note Nissim Ait-Kassimi dans les Echos.

Les cryptomonnaies : comme on l’a vu, les premiers métavers disposaient déjà de leur propre monnaie au début des années 2000, une opportunité pour les cryptomonnaies comme le bitcoin ou l’Etherum qui développe d’ailleurs sa propre plateforme.

Quelles technologies pour les métavers : infrastructures et équipements

Au dernier salon CES à Las Vegas, les objets du métavers tenaient le haut du pavé d’après l’article de Meta-Media: casques de réalité virtuelle, vêtements à sensation haptique (toucher), micros, cartouches olfactives, etc.

Au dernier salon CES à Las Vegas, les objets du métavers tenaient le haut du pavé d’après l’article de Meta-Media: casques de réalité virtuelle, vêtements à sensation haptique (toucher), micros, cartouches olfactives, etc.

Mais ces équipements, bien qu’indispensable à une pratique virtuelle sont secondaires par rapport aux infrastructures des plateformes et surtout des relations entre elles comme l’interopérabilité.

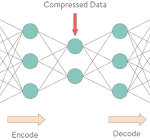

« Pour rendre le monde virtuel crédible, il faudrait une puissance de calcul 1000 fois plus puissante que celle dont on bénéficie aujourd’hui » c’est le constat d’un cadre d’Intel, cité par Corentin Béchade de Numérama. Pour rendre les avatars convaicants, on doit disposer de capteurs détectant les objets en 3D dans le monde réel (les gestes, les sons), et ce multiplié par des centaines de millions d’utilisateurs simultanément. « Notre infrastructure de stockage et de mise en réseau actuel n’est tout simplement pas suffisante pour permettre cette vision » selon Roja Koduré d’Intel. Le temps de latence (temps de réaction) doit aussi être réduit pour ne pas ‘lagger’ (traîner) sur le métavers !

Aujourd’hui seuls les pays les plus riches peuvent se doter de l’infrastructure et de moyens économiques suffisants pour créer un monde virtuel.

Le coût écologique est aussi très important. Dans l’empreinte carbone du numérique, 70% concerne les terminaux (casques VR, objets connectés).

L’interopérabilité

Un des défaut des jeux vidéo est le manque d’interopérabilité entre les différentes applications et supports ; chacun est sensé rester sur la même plateforme ou la même console. Avec l’interopérabilité, on pourra acheter des vêtements sur Roblox et assister à un film sur Fortnite.

Les enjeux éthiques et politiques induits par les métavers

Les métavers semblent se constituer à partir de considérations essentiellement marchandes. Pourtant, les politiques devraient se soucier aussi de ce qui se passe dans ces mondes virtuels. Comme le souligne Matthias Hauser dans l‘article du portail-ie « Mais dans cette effervescence, il est nécessaire d’évoquer une question cruciale que peu de gens évoquent : celle du rapport de force qui opposera les Etats aux entreprises privées dans ce nouvel écosystème de républiques numériques. »

Alors que jusqu’en 2020 la frontière restait très claire entre le monde réel et le monde virtuel, essentiellement dédié aux jeux. Depuis la crise sanitaire et les confinements, les entreprises du monde réel y voient un moyen d’asseoir la puissance qu’ils ne peuvent plus exercer dans un monde sous confinement. Elles ont organisé des événements comme les concerts sur Fortnite ou les défilés de mode sur Decentraland. Des entreprises sont prêtes à débourser des centaines de milliers de dollars pour des encarts publicitaires virtuels, des terrains virtuels ou des objets virtuels.

L’addiction

Le passage du monde réel à un monde virtuel passe par la liberté apportée par l’utilisation des mondes virtuels, qui va parfois jusqu’à une désinhibition totale et même provoquer une addiction, concept compliqué qui ne peut se comprendre en restant au niveau du virtuel. Gregory Maubon se demande dans Augmented Reality « Serons-nous plus attiré par un Metaverse “idéal” si le monde réel devient plus angoissant, moins capable de nous satisfaire ? « Comme le dit le psychologue Michael Stora “Nous ne sommes pas tous égaux dans notre capacité à aimer le réel” et la génération Z semble avoir plus de désillusions. Est-ce un bon modèle économique de proposer du bonheur en ligne ? Cela peut-il nous amener à des conséquences dramatiques pour les utilisateurs ? ».

Le métavers n’est pas un monde meilleur, c’est toujours le monde capitaliste mondialisé, un univers marchand, coordonné et régi par les multinationales du numérique. Les innovations techniques ne sont pas destinées à développer la productivité, mais à assurer des rentes aux multinationales ! Comme l’analyse Romaric Godin dans Médiapart « on n’est pas loin de l’idée d’enclosure qui a tant contribué à la constitution du capitalisme ». Le journaliste évoque La Société du spectacle de Guy Debord « Le ‘spectacle’ est précisément cette forme que prend le capital réduit à trouver de la valeur hors du monde réeL « La marchandisation se contemple elle-même dans le monde qu’elle a créé. C’est un ‘leurre qui produit une ‘fausse conscience du désir dans le seul intérêt de la marchandise ».

Matthias Hauser insiste aussi sur ce point « le pouvoir déjà acquis par les GAFAM dans la version actuelle du web leur donne un temps d’avance considérable dans la course au métaverse. » Ces entreprises « sont des quasi-Etats, elles en ont la puissance économique qui commence à s’étendre aux sphères politiques, financières et sociétales ». Avec le métavers, les GAFAM pourront prendre le contrôle sur nos données professionnelles, sociales, financières et de notre vie privée …

Données personnelles

Si le recueil de données personnelles est déjà important sur le web, il va devenir explosif sur le métavers. Grâce aux différents capteurs, le moindre mouvement de nos avatars sera examiné et suivi … Mouvements des yeux, expressions du visage, allure, etc. Selon Edward Back de Futura « Le Financial Times a passé en revue des centaines de demandes de brevets déposés par Meta aux États-Unis au cours de l’année écoulée, dont beaucoup ont été accordés, pour mieux comprendre la vision d’avenir de la firme. » Beaucoup de ces brevets portent sur des systèmes de capteurs qui ont pour objectif « de créer des copies 3D des personnes et objets tellement réalistes qu’ils sont impossibles à distinguer de l’original. Le système a été décrit comme « un programme de clonage humain ».

Si le recueil de données personnelles est déjà important sur le web, il va devenir explosif sur le métavers. Grâce aux différents capteurs, le moindre mouvement de nos avatars sera examiné et suivi … Mouvements des yeux, expressions du visage, allure, etc. Selon Edward Back de Futura « Le Financial Times a passé en revue des centaines de demandes de brevets déposés par Meta aux États-Unis au cours de l’année écoulée, dont beaucoup ont été accordés, pour mieux comprendre la vision d’avenir de la firme. » Beaucoup de ces brevets portent sur des systèmes de capteurs qui ont pour objectif « de créer des copies 3D des personnes et objets tellement réalistes qu’ils sont impossibles à distinguer de l’original. Le système a été décrit comme « un programme de clonage humain ».

C’est aussi ce que craint Régis Chatellier du LINC-Cnil : « Le – ou les – métavers restent néanmoins des dispositifs numériques où l’extension du domaine de la collecte des données pourrait s’avérer problématique si leur développement n’est pas maîtrisé. ». Dans cet ‘internet augmenté’, « une transformation des interfaces ne va pas sans la transformation des modalités de la collecte des données ». Même si Facebook a promis de réduire la quantité de données utilisées et de respecter la vie privée des utilisateurs en leur octroyant la transparence et le contrôle de leurs données, « d’un point de vue de la protection des données et des libertés, la véritable question à se poser réside dans les risques d’augmentation associée – et potentiellement exponentielle – de collecte des données, et d’un usage toujours plus massif de celles-ci. ». Car le métavers réduit la capacité individuelle d’échapper à la collecte de données, garantie aussi bien par le RGPD que le règlement ‘vie privée et communications électroniques’- e-Privacy. Les ‘conditions générales d’utilisation’ du système deviennent la loi. « Faudra-t-il redéfinir une ‘sphère privée virtuelle’ dans le métavers lui-meme et la protéger des intérêts commerciaux et régaliens ? »

Plus dramatiquement, c’est la souveraineté des États qui est remise en cause. Dans la situation ou tout ou partie de l’activité humaine se passait dans le métavers, « l’Etat se trouverait dépossédé de la plupart de ses prérogatives : police, justice, émission de la monnaie, taxes, etc. Il disparaîtrait presque totalement face à des entreprises privées ». En effet, que pourrait faire la puissance publique face à des citoyens qui convertissent les euros qu’ils gagnent dans le monde réel en cryptomonnaie pour les dépenser dans le métavers ? Si 30% de la population achète des vacances virtuelles ou des appartements virtuels en payant des taxes virtuelles ?

Les mondes virtuels où vivront nos enfants seront-ils encore sous le contrôle d’un État ? « Ou bien sous le contrôle de quelques entreprises qui émettront leur monnaie virtuelle, choisiront leurs taux d’intérêt virtuel et feront de leurs ‘Terms of Service’ le nouveau Code Civil, qui nommeront une police virtuelle pour exclure de ce monde (et du monde) les utilisateurs problématiques. »

A cet question Régis Chatellier essaie d’apporter un peu d’espoir dans son post sur LINC-CNIL « Ce nouvel internet immersif, s’il offre des perspectives alléchantes pour certains autant qu’inquiétantes pour les libertés pourrait aussi permettre le développement de modèles alternatifs et variés afin que le gagnant ne soit pas celui qui remporte l’ensemble du marché (Winners take all) ». Comme dans les forums de discussion des années 2000 où dans certaines communautés de Seconde Life, on pourrait « réguler ces espaces afin que les utilisateurs puissent naviguer et se mouvoir dans des univers interopérables respectueux et transparents ».

Pour aller plus loin

Charles, Frédéric. – Le métavers s’emballe déjà. – ZDNet, 22/01/2022

Facebook : le métavers pourrait revendre des données sur nos expressions faciales à des fins publicitaires. – 20 minutes, 20/01/2022

Gariffo, Michael. – Le paris géant de Microsoft sur Activision Blizzard ? Son billet pour le métaverse. - ZDNet, 20/01/2022

Fillioux, Frédéric. – Roblox, porte d’entrée des enfants vers le métavers. – L’Express, 19/01/2022

Moirand, Emmanuel. – Pourquoi aller dans le métaverse sans attendre ? - Journal du Net, 18/01/2022

Aït-Kacimi, Nessim. – Les NFT restent le segment le plus dynamique du marché des cryptos. – Les Echos, 18/01/2022

Carriat, Julie. - Jean-Luc Mélenchon marque les esprits par son meeting immersif. – Le Monde, 17/01/2022

Sample, Ian. – ‘Virtual reality is genuine reality’ so embrace it, says philosopher. - The Guardian, 17/01/2022

Fievet, Cyril. – Crypto, métaverse, intelligence artificielle, robotique : quelles sont les grandes tendances techno en 2022 ? – Clubic, 16/01/2022

Jonniaux, Amandine. – 20 ans plus tard, Second Life veut devenir le premeir Métaverse. – Journal du Geek, 16/01/2022

Bremme, Kati. - CES 2022 : la tech se rue sur le métavers. – Meta-Média, 15/01/2022

Dicharry, Elsa. – Métavers : l’immobilier virtuel fait des premiers pas retentissants. – Les Echos, 11/01/2022

Breton, Olivier. – Méta, métavers, la fin de nos libertés. - CBNews, 06/01/2022

Hauser, Mathias. – Le métaverse, enjeu de souveraineté (2/2). – Portail de l’IE, 07/01/2022

Hauser, Mathias. – Le métaverse, enjeu de souveraineté (1/2). - Portail de L’IE, 05/01/2022

Stocker-Walker, Chris. - The metaverse : What it is, will it work, and does anyone want it? – New Scientist, 05/01/2022

Klein, Anne-Lise. – Métaverse : Decentraland (MANA) lance sa première semaine de mode. - Cointribune, 28/12/2021

Fagot, Vincent. - Le métavers, prochaine génération d’internet, pourrait rabattre les cartes du numérique. – Le Monde, maj 27/12/2021

Métavers : Baidu lance son application de monde parallèle virtuel. – Le Monde, 27/12/2021

Gayte, Aurore. – Zepeto, un métaverse que vous ne connaissez pas et qui a des centaines de milliers d’utilisatrices. – Numérama, 24/12/2021

Béchade, Corentin. – Pour faire tourner le métaverse, il faudra changer l' »infrastructure entière de l’internet ». – Numérama, 17/12/2021

Godin, Romaric. – La marchandisation du virtuel : la fuite en avant du système économique. – Médiapart, 08/12/2021

Crète, David. – Le Métavers de Facebook, prison ou révolution ? - The Conversation, 30/11/2021

Chow, Andrew R. – 6 lessons on the future of Metaverse from the creator of Second Life. – Time, 26/11/2021

Josué, Frédéric. – Métavers, internet liquide, média organique ou comment prendre des décisions dans la complexité du métavers. – Méta-média, 13/11/2021

Chatellier, Régis. – Métavers : Réalités virtuelles ou collectes augmentées. – LINC, 05/11/2021

Roach, John. – Mesh for Microsoft Teams aims to make collaboration in the metaverse personnal and fun. Microsoft - Innovation Stories, 02/11/2021

Maubon, Grégory. – Le métaverse sera-t-il un monde idéal ou un cauchemar agréable ? Discussion avec Michael Stora. - Augmented reality, 20/09/2021

Fievet, Cyril. – Métaverse : de la science-fiction au projet tangible, histoire d’une idée folle devenue incontournable. – Clubic, 29/09/2021

Maillé, Pablo. – ‘Metavers’ : Quand Zuckerberg rêve d’un monde 100% Facebook – Usbek & Rica, 30/07/2021

Stephenson, Neal ; Abadia, Guy (trad). – Le Samourai virtuel. – Livre de Poche, 2017 (collection imaginaire)